理论计算机科学家 Boaz Barak:深度学习并非“简单的统计”,二者距离已越来越远(4)

扫一扫

分享文章到微信

扫一扫

关注99科技网微信公众号

与上述相反,我们来谈谈教学生一些特定的数学题目(如计算导数),给予他们常规指导及要做的练习。这不是一个正式定义的设置,但可考虑它的一些定性特征:

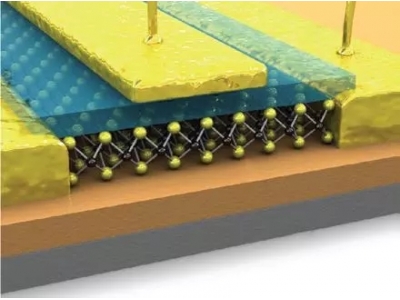

图注:从IXL 网站学习特定数学技能的练习 学习一项技能,而不是近似分布。在这种情况下,学生是学习一种技能,而非某个数量的估计器/预测器。虽然定义“技能”不是一项微不足道的任务,但却是一个性质不同的目标。特别是,即使函数映射练习不能用作解决某些相关任务 X 的“黑匣子”,但我们相信,学生在解决这些问题时所形成的内部表征,仍是对 X 有用的。 越多越好。一般来说,学生练习更多问题和不同类型问题,会取得更好的成绩。但事实上,“混合模型”——做一些微积分问题和代数问题——不会影响学生在微积分上的表现,反而会帮助他们学习。 “探索”或解锁功能,转向自动表示。虽然在某些时候解决问题也会出现收益递减,但学生似乎确实经历了几个阶段,有的阶段做一些问题有助于概念“点击”并解锁新功能。另外,当学生们重复某一特定类型的问题时,他们似乎将自己的能力和对这些问题的表述转移至较低的水平,使他们能够对这些问题产生某些以前所没有的自动性。 性能部分独立于损失和数据。教授数学概念的方法不止一种,即使学生使用不同书籍、教育方法或评分系统学习,但最终仍可学习到相同的材料和相似的内部表示。 一些问题更难。在数学练习中,我们经常可以看到不同学生在解决同一个问题时所采取的方法存在很强的相关性。一个问题的难度似乎是固定的,解决难题的顺序也是固定的,这就使学习的过程能够优化。这事实上也是IXL等平台正在做的事情。 深度学习更像统计估计还是学生学习技巧?

那么,上述两个比喻中,哪个更恰当地描述了现代深度学习,特别是它如此成功的原因呢?统计模型拟合似乎更符合数学和代码。实际上,规范的 Pytorch 训练循环,就是通过如上所述的经验风险最小化来训练深度网络的:

然而,在更深层次上,这两种设置之间的关系并不那么清楚。具体而言,可以通过修复一个特定的学习任务来展开,使用“自监督学习 + 线性探头(linear probe)”的方法训练分类算法,其算法训练如下: 1、假设数据是一个序列 ,其中 是某个数据点(例如具体的图像)、 是一个标签。

2、首先找到一个深度神经网络来表示函数 ,这个函数的训练只使用数据点 而不使用标签,通过最小化某种类型的自监督损失函数。这种损失函数的例子是重建或画中画(从另一个输入 x 的某些部分恢复)或对比学习(找到 使 显著更小,当 是同一个数据点的增量时,并列关系比两个随机点的并列关系要小得多)。

99科技网:http://www.99it.com.cn

推荐资讯

推荐资讯