ChatGPT实践问题分析与应用展望(3)

扫一扫

分享文章到微信

扫一扫

关注99科技网微信公众号

多场景问题

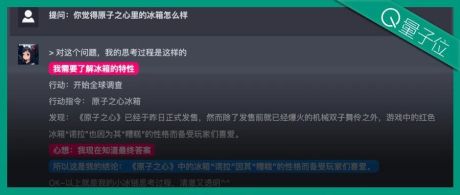

一是标注数据 。 诸如回答内容存在事实性错误,对于确定的事实,其给出的答案无法达到高置 信度,对于常识性的知识问题不能高效地给出符合日常认知的答案。大模型训 练所需语料涉及面非常广,仅就人文学科而言,就存在非常庞杂的知识的语料,因此,在标注过程中,相关任务对标注人员的知识面、逻辑思考能力等都有极高的要求。在此基础上,还需要针对更多语料中提及的知识进行自动抽取,反复校验,才可一步步改进。如下图, 关于古 诗《登鹳雀楼》的提问,ChatGPT未能给出符合常识的回答, 包括古诗的原文和 作者信息。

二是数据理解。 对于简单的数据说明可以顺利地进行比较分析,但面对略复杂的语义理解要求回答比较困难,对于中文丰富的词汇体系、语法和句法的特点,特别是涉及近义词之间的差别和近义程度的区分,还需要补充更多更广泛的训练数据、做进一步的训练和优化,才能修正相应问题。示例如下图。

99科技网:http://www.99it.com.cn

ChatGPT核心方法可用于AI绘画,效果飞升47%,通讯作者:已跳槽OpenAI

ChatGPT核心方法可用于AI绘画,效果飞升47%,通讯作者:已跳槽OpenAI

ChatGPT中有这样一个 核心训练方法 ,名叫“ 人类反馈强化学习 (RLHF) ”。

快资讯2023-02-28

推荐资讯

推荐资讯